„Menschliche“ Gehirnarchitektur für Maschinen

Archivmeldung vom 25.06.2020

Bitte beachten Sie, dass die Meldung den Stand der Dinge zum Zeitpunkt ihrer Veröffentlichung am 25.06.2020 wiedergibt. Eventuelle in der Zwischenzeit veränderte Sachverhalte bleiben daher unberücksichtigt.

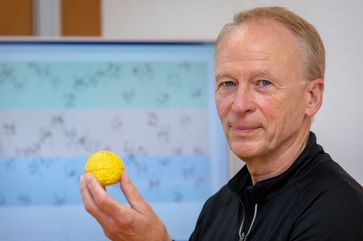

Freigeschaltet durch Thorsten SchmittKonkret ist es den Forschenden gelungen, das Entstehen und Interagieren zwischen sogenannten „Assemblies“ mathematisch zu modellieren. Dabei handelt es sich um Neuronenverbände im Gehirn, die die Grundlage für höhere kognitive Fähigkeiten bilden wie beispielsweise dem Denken, dem Vorstellungsvermögen, dem Argumentieren, Planen oder der Sprachverarbeitung.

Besseres Verständnis für die Funktionsweise des Gehirns

Der kanadische Neurowissenschaftler Donald H. Hebb hat bereits 1949 postuliert, dass sich Neuronen zu solchen Verbänden zusammenschließen, also gemeinsam aktiv sind, um einzelne Wörter oder Symbole, aber auch ganzheitliche „Konzepte“ zu kodieren. „Die Existenz von Assemblies verdichtete sich allerdings erst in den letzten Jahren und unsere Modelle bauen auf den jüngsten Ergebnissen aus der Hirnforschung auf“, erklärt Maass.

Assemblies sind fließende Gebilde, die sich ständig neu organisieren, um Umweltreize zu verarbeiten, diesen eine symbolische Bedeutung geben, sie strukturieren und in Wissen umwandeln. Diese Anpassungsfähigkeit – auch Plastizität genannt – liefert dem Gehirn die Möglichkeit, über die begrenzte Verarbeitungskapazität hinwegzukommen und eine „unbegrenzte“ Anzahl von Mustern zu bilden.

Die Ergebnisse tragen nicht nur zu einem besseren Verständnis des Gehirns bei – sie könnten auch zu neuen effizienten AI-Methoden führen, da sie die Vorteile der zwei Hauptansätze in der AI-Forschung miteinander verbinden – der symbolistische und der konnektionistische.

Symbolistische vs. Konnektionistische Informationsverarbeitung

Algorithmen in Symbolsystemen basieren auf definierten Regeln (Wenn-/Dann-Befehle) und logischen Formeln, und überzeugen durch ihre Abstraktionsfähigkeit – also einerseits die Fähigkeit zur Verallgemeinerung sowie andererseits die Fähigkeit, allgemeine Zusammenhänge auf konkrete Sachverhalte anzuwenden. Sie sind daher prädestiniert für eine leichte Anwendung auf ganz neue Situationen. Symbol-basierte Systeme müssen aber aufwendig programmiert werden und lassen sich nicht mittels großer Datenmengen für anspruchsvolle Anwendungen trainieren, wie das bei neuronalen Netzwerken möglich ist. Diese bestehen aus kleinen miteinander vernetzten und lernfähigen Recheneinheiten, die sich selbst organisieren und im Verbund komplexe Probleme schnell lösen können. Die Lernfähigkeit neuronaler Netzwerke hat den konnektionistischen Ansatz für die aktuelle AI-Forschung und für moderne AI-Anwendungen attraktiver gemacht. Allerdings haben neuronale Netzwerke Schwierigkeiten bei jenen Aufgaben, die in den Trainingsmengen nicht vorkommen.

„Menschliche“ Gehirnarchitektur für Maschinen

Die vorgestellten Assembly-Modelle zielen nun darauf ab, die Abstraktionsfähigkeit mit der Lernfähigkeit zu kombinieren. „Es handelt sich dabei um neuronale Netzwerke, die mit ihren Assemblies symbolartig arbeiten. Als Paradigma dient uns das menschliche Gehirn, das auch beides miteinander kombiniert“, so Legenstein.

Die Arbeiten, an denen auch Forschende der University of Nottingham, der University of California, Berkeley und dem Georgia Institute of Technology beteiligt sind, fließen teilweise ins Human Brain Project ein (HBP) – dieser europaweite interdisziplinäre Forschungsverbund arbeitet seit 2015 daran, das menschliche Gehirn elektronisch nachzubauen und seine Funktionen zu simulieren. Wolfgang Maass und sein Team sind darin für das Arbeitspaket „Principles of Brain Computation“ verantwortlich.

Diese Forschungsarbeit wurde vom Wissenschaftsfonds FWF sowie durch das Human Brain Project gefördert und ist an der TU Graz in den Fields of Expertise „Human and Biotechnology“ und „Information, Communication & Computing“ verankert, zwei von fünf Stärkefeldern der TU Graz.

Quelle: ABA - Invest in Austria